AI Design Workflow2026.05

Vol.01

GPT IMAGE 2 · SEEDANCE 2.0

图像之后

设计工作流从“出图”进入“出镜头”的时代

GPT Image 2 负责把意图、参考图和品牌约束编译成高质量静帧;Seedance 2.0 负责把静帧推进为可控镜头。设计师的核心工作,正在从像素生产迁移到系统调度。

Internal TalkDesign / Product / Growth20 min

模型发布与设计工作流变化

OpenAI · ByteDance Seed

Release SignalWhat Changed

02 / 16

先看信号,再谈方法

图像不再是终点

它变成了一个可编辑、可引用、可动画化的中间产物。

Snapshot

04.21

OpenAI 文档列出 `gpt-image-2-2026-04-21` 快照。

Input

Text+图

GPT Image 2 支持文本输入与高保真图像输入。

Output

4K

最高边长 3840px,总像素有上限,适合多规格输出。

Cost Sample

$0.041

1536×1024 medium 输出的官方估算区间样例。

Seedance

15秒

Seedance 2.0 官方发布稿称支持 15 秒高质量多镜头音视频输出。

Video Cost

≈1元/秒

公开报道援引火山方舟计费:纯生成约 46 元/百万 tokens。

数据为 2026-05-02 可见资料口径

Act I · Signals

Role ShiftDesigner As Director

03 / 16

核心变化不是更快画图

设计师不再只是画稿, 而是在导演一条生成链。

静态视觉、风格一致性、镜头运动、投放变体,第一次可以被放在同一个生产系统里讨论。

从“单张图”到“资产流水线”

Shift · 01

Before / AfterWorkflow

04 / 16

旧工作流和新工作流的差别

交付物变了

BEFORE · STATIC DELIVERY

Brief → Moodboard → KV → 手动修图 → 动效外包

慢在沟通,贵在返工

资产

单张稿件,复用依赖人工记忆。

反馈

“再高级一点”“再年轻一点”,语义含混。

视频

通常是另一个团队、另一个排期。

AFTER · GENERATIVE PIPELINE

Intent → Reference → GPT Image 2 → Seedance 2.0 → Review → Asset Library

慢在判断,快在执行

资产

静帧、镜头、Prompt、约束一起沉淀。

反馈

变成风格、构图、运动、镜头语言的参数化批注。

视频

从创意早期就进入验证,不等最终稿。

变化点:不是替换 Figma,而是把上游和下游连起来

Workflow · Before After

Act IINew Role

05 / 16

Act II · 从制图员到导演

新角色

设计师要写的不是更长的 prompt,而是更清楚的判断标准:什么可用、什么要淘汰、什么值得继续生成。

角色变化 · Role Design

Act II

Model CombinationPipeline

06 / 16

组合操作:先锁静帧,再推镜头

一条可执行流水线

演示时按右键逐步点亮。关键不是“一次生成完”,而是把每一步都变成可以复盘的中间件。

Stage A · Visual Intent

01

输入约束

品牌词库、禁用词、参考图、版式比例、目标渠道。

02

生成静帧

用 GPT Image 2 出 3-6 张方向稿,优先低/中质量快速筛选。

03

局部编辑

用参考图和 mask 修主体、道具、文字区域和构图关系。

04

冻结母版

确定一张 style frame,生成多比例、多语言、多场景版本。

Stage B · Motion Direction

05

镜头说明

写清运动、景别、节奏、光线变化和不能动的元素。

06

图生视频

把静帧送入 Seedance 2.0,让它补时间、物理和音画节奏。

07

人工验收

检查品牌一致、文字清晰、物理合理、人物和版权风险。

08

沉淀资产

保留 prompt、参考图、参数、失败样本和验收理由。

Prompt 不是灵感记录,而是生产配方

Pipeline · 08 Steps

GPT Image 2Principle

07 / 16

它像一个视觉编译器

不是贴图机器

GPT Image 2 的变化在于:更强的世界知识、指令遵循和复杂细节生成。对设计工作来说,这意味着它更能理解“为什么这样画”。

把它当成 visual compiler:输入意图、参考和约束,输出可继续编辑的静态视觉。

Source · OpenAI Images 2.0 system card / Image API guide

输入

文本、参考图、局部 mask、多张参考资产。

推理

thinking mode 可把推理、工具使用和网络信息整合进图像生成流程。

输出

多规格图片、局部编辑结果、可作为视频首帧的 style frame。

限制

仍可能在精确文字、结构化排版和跨批次一致性上出错。

原理拆解 · GPT Image 2

Tech · Image

Seedance 2.0Principle

08 / 16

它补齐了时间维度

静帧变镜头

Seedance 2.0 采用统一的多模态音视频联合生成架构,支持文字、图片、音频、视频输入,并强调运动稳定、物理还原、音画同步和导演级控制。

01

多模态参考

官方发布稿提到可同时参考多张图片、视频片段、音频片段和自然语言指令。

02

运动与物理

更适合多主体互动、复杂运动、镜头移动和物理连续性场景。

03

音画联合

不是只让画面动起来,而是把声音、节奏和画面作为同一条生成任务。

04

工业级输出

官方强调影视、广告、电商、游戏等场景的内容制作效率提升。

原理拆解 · Seedance 2.0

Tech · Video

Cost ModelBudget

09 / 16

成本不是“贵不贵”,而是放在哪个阶段

先便宜试错,

再昂贵确认

IMAGE · GPT Image 2

1536×1024 官方估算样例: low $0.005, medium $0.041, high $0.165。

价格还要加文本输入和参考图输入 token

草稿

低质量、多方向、快速淘汰。

定稿

中/高质量,用在母版和关键宣传图。

VIDEO · SEEDANCE 2.0

公开口径:含视频输入 28 元/百万 tokens;纯生成 46 元/百万 tokens。

15 秒约 30.888 万 tokens,纯生成约 14.2 元

预演

先短镜头验证运动,不要一开始生成长片。

投放

只把通过验收的静帧送入视频阶段。

结论:图像阶段负责抽样,视频阶段负责验证

Cost · Stage Gate

Use CasesDaily Work

10 / 16

它能解决哪些日常工作

六个高频场景

01 · Concept

概念板

把模糊方向变成可讨论的视觉板。

02 · Campaign

主视觉

快速比较 3-6 套 KV 方向和色彩系统。

03 · Product

产品图

生成包装、材质、场景和不同平台比例。

04 · Social

短视频

用静帧变 5-15 秒动态物料。

05 · Storyboard

分镜

让脚本、构图和镜头节奏提前暴露问题。

06 · Localization

本地化

按国家、渠道、语言快速扩展同一创意。

日常工作不是消失,而是被重新排序

Use Cases · 06

Reality CheckHuman Review

11 / 16

这里不能全自动

别急自动

模型降低的是执行成本,不是判断成本。品牌、版权、人物肖像、文字准确性、物理连续性,仍然需要人工验收。

Review GateBrandLegalQuality

不要把生成结果直接当最终交付

Risk · Human In Loop

Operating SystemTeam Habit

12 / 16

团队真正需要建立的不是工具账号

而是一套验收语言

Brand Fit

是否符合品牌语气、材质、人物、构图和禁用边界。

品牌

Visual Logic

光源、透视、手部、材质、镜面和空间关系是否可信。

画面

Text Safety

画面中文字是否拼写准确、是否需要后期重排或在 Figma 中覆盖。

文字

Motion Logic

镜头运动是否服务信息,主体是否漂移,动作是否有因果。

视频

Rights Check

是否涉及真人肖像、商标、训练素材争议或平台发布限制。

法务

判断标准写得越清楚,模型越像团队成员

OS · Review Language

Prompt PatternHow To Operate

13 / 16

可复制的操作模板

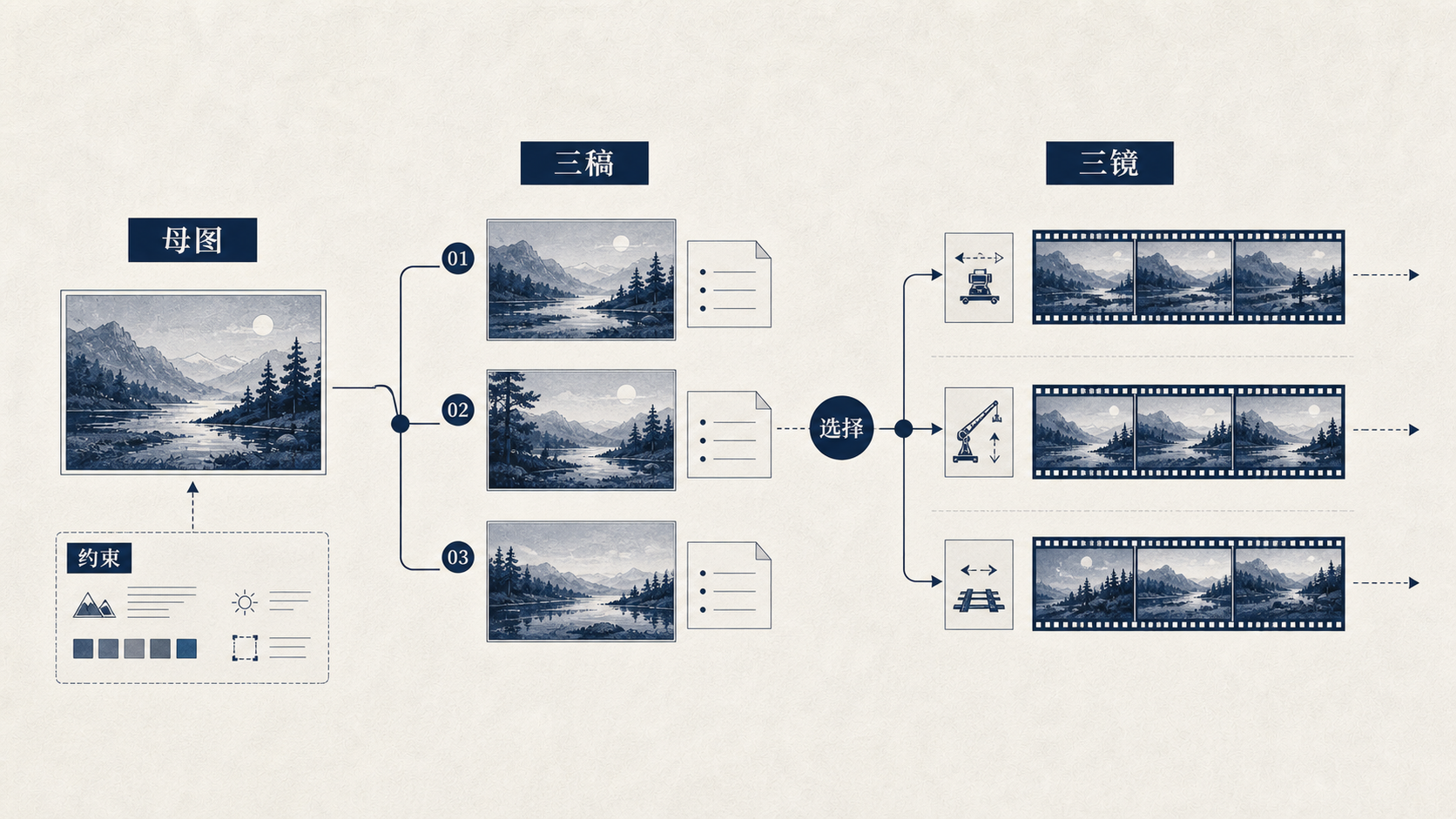

一图三稿,

一稿三镜

不要让模型“自由发挥”。每次都把目标、限制、评判标准和下一步用途写进去。

GPT Image 2 prompt

目标:生成品牌发布主视觉。参考:产品图、品牌色、竞品风格。限制:不要生成文字,保留右侧 30% 留白。输出:3 个方向,分别偏理性、温暖、未来感。

Seedance motion brief

以选中的 style frame 为首帧。镜头:缓慢推近,产品保持中心稳定。光线:左侧高光轻微移动。动作:背景粒子低速漂移。禁止:主体变形、文字出现、Logo 漂移。

一句 prompt 不够,要给模型一个生产上下文

Pattern · One To Many

Future DirectionWhere It Goes

14 / 16

未来不是更像摄影师

而是更像设计系统

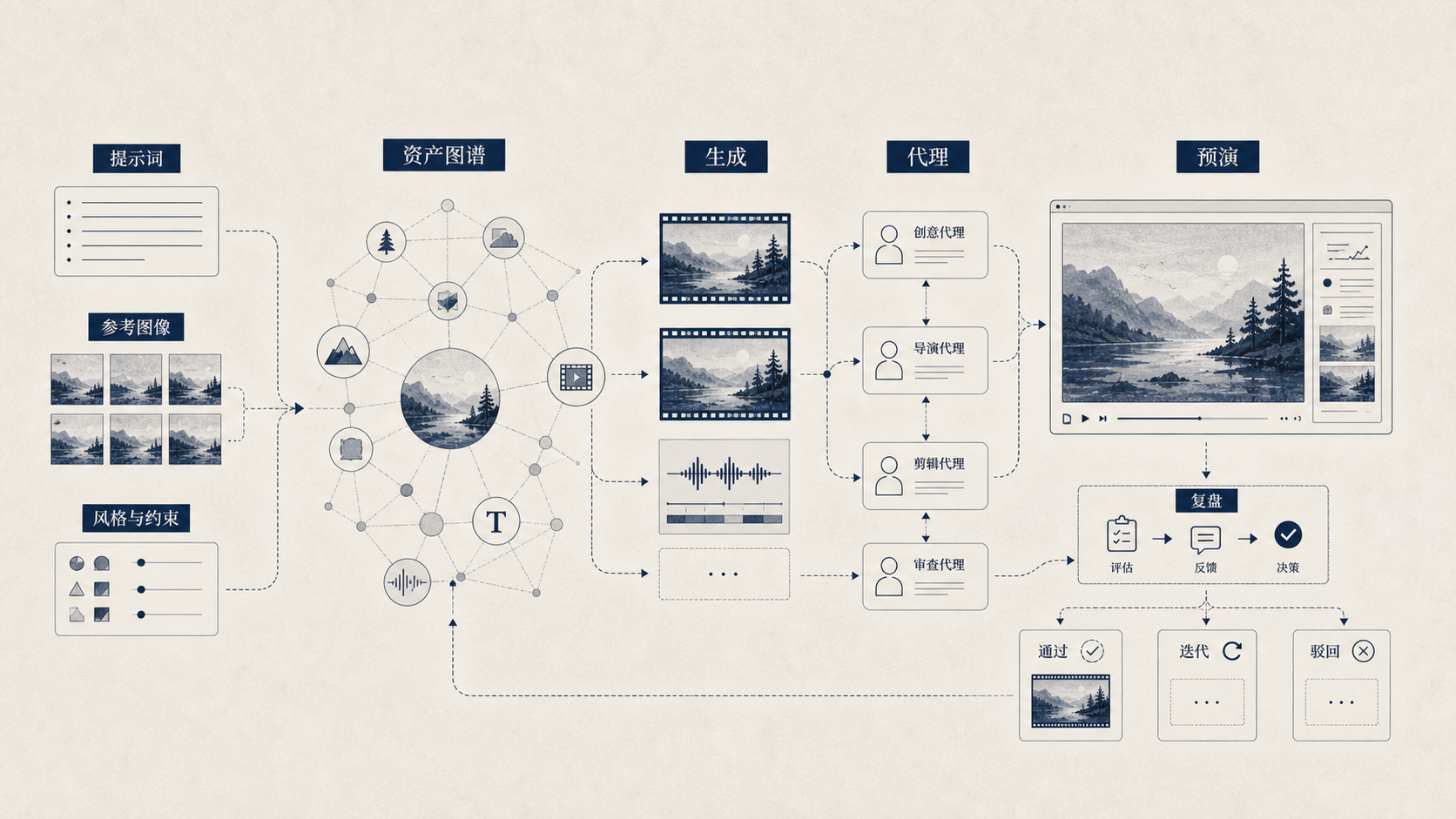

A

资产图谱

Prompt、参考图、成片、失败样本和审核结论会一起进入团队资产库。

B

多代理流水线

一个代理出静帧,一个代理写镜头,一个代理检查品牌和法务风险。

C

实时预演

设计评审从看稿变成看动态原型,创意早期就能看见传播形态。

真正的未来方向:模型从“帮我做一张图”,走向“帮我维护一套可迭代的视觉生产系统”。

未来方向 · asset graph / agents / realtime preview

Future · 03

TakeawayClose

15 / 16

最后只记三句话

三句话

01

GPT Image 2 是静帧编译器

用它锁方向、锁风格、锁品牌约束。

02

Seedance 2.0 是镜头推进器

用它验证运动、节奏和动态传播。

03

设计师是系统导演

价值不在手速,而在判断、取舍和沉淀。

Takeaway · Design As Direction

End · 01

SourcesResearch Notes

16 / 16

资料来源与口径

以官方为主,

价格以控制台为准

OpenAI Model

GPT Image 2 model page: model capability, modalities, endpoints, snapshot `gpt-image-2-2026-04-21`.

developers.openai.com

OpenAI Guide

Image generation guide: Image API / Responses API choices, sizes, quality, costs and limitations.

developers.openai.com

System Card

ChatGPT Images 2.0 system card: world knowledge, instruction following, thinking mode and safety stack.

openai.com

Seedance

ByteDance Seed official launch pages: unified multimodal audio-video architecture, control and 15-second output claims.

seed.bytedance.com

Cost Note

Seedance 2.0 pricing section uses public reports citing Volcano Engine / Ark billing. API availability and exact bill should be checked in the current console before production use.

stcn.com / nbd.com.cn

生成时间: 2026-05-02 · 主题: 靛蓝瓷

Sources · Appendix